Robots.txt no WordPress – Controle a indexação.

Garantir que os buscadores irão indexar o seu site com seus robôs é uma tarefas das mais difíceis. Você deve estudar o máximo possível das técnicas de SEO e trabalhar duro para que suas páginas apareçam nas buscas e isso gere tráfego no seu site.

Porém, não é tudo que está no seu site que deve ser indexado pelo Google, e você pode proibir que certas páginas não sejam indexadas.

Controle da indexação no WordPress

Leia também

Cada mecanismo de busca tem os chamados “robots”, “spiders” ou “crawlers”, que são algoritmmos projetados para varrer as páginas da Internet e indexar o conteúdo para que apareça nas pesquisas realizadas.

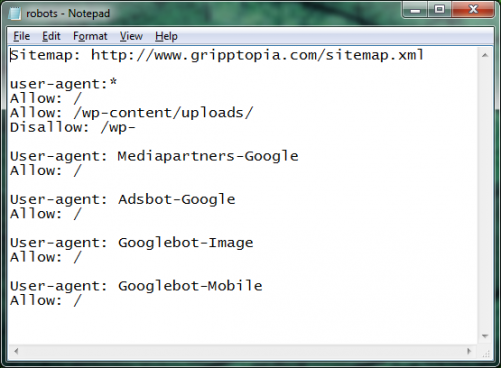

Para evitar que estes robôs de busca indexem tudo que está no seu site, você pode criar um arquivo chamada robots.txt, e coloca-lo na pasta raiz do seu site. Em outras palavras, este arquivo indica o que os robôs de buscas NÃO devem indexar.

Através do robots.txt no WordPress, você poderá orientar os indexadores para o que deve e não deve ser indexado do seu site no WP. (Foto: ethicalweb.blogspot.com)

Por exemplo: neste site, o robots.txt está no seguinte endereço: http://www.palpitedigital.com.br/robots.txt

Para evitar que informações desnecessárias sejam indexadas, você pode bloquear alguns diretórios do WordPress.

Coloque as seguintes linhas no seu arquivo robots.txt.

User-agent: *

Disallow: /cgi-bin

Disallow: /wp-

Disallow: /feed/

Disallow: /trackback/

Com as linhas acimas, você evitará que os diretórios listados sejam indexados pelos mecanismos de busca. Isto fará com que a indexação do seu site tenha melhor qualidade, focando apenas nos artigos e páginas, ao invés de pegar qualquer arquivo “solto” que estivesse nestes diretórios.

Fonte: WebBrander

Sobre o autor

Profissional de TI com mais de 20 anos de experiência na indústria. Bacharel em Matemática Computacional, sempre aprendendo sobre tecnologia, jogos, desenvolvimento de software e automação. É criador do site Palpite Digital onde compartilha conhecimentos desde 2007!

Veja também

Abrir e visualizar .docx e .xlsx sem instalar o Office! Visualizadores da Microsoft!

Uno: um carro fácil de arrombar. Veja o estrago após o roubo do rádio

Como descobrir o IP de um site?

Como compactar vídeos?